Сегодня OpenAI официально запускает две новые модели: o3 и o4-mini – самые продвинутые версии в серии моделей “o”, обученные дольше размышлять перед ответом. Это самые умные модели из когда-либо выпущенных, позволяющие ChatGPT справляться со сложными задачами с глубокими возможностями рассуждения и проактивным использованием инструментов.

Впервые эти модели могут использовать полный набор инструментов в ChatGPT: веб-поиск, чтение и анализ файлов с помощью Python, обработку изображений и генерацию изображений. Они разработаны для автономного принятия решений о том, когда и как использовать инструменты, отвечая быстро (часто менее чем за 1 минуту) в соответствующем формате вывода.

🚀 Ключевые новые возможности

o3-mini

- Самая мощная модель рассуждения на сегодняшний день

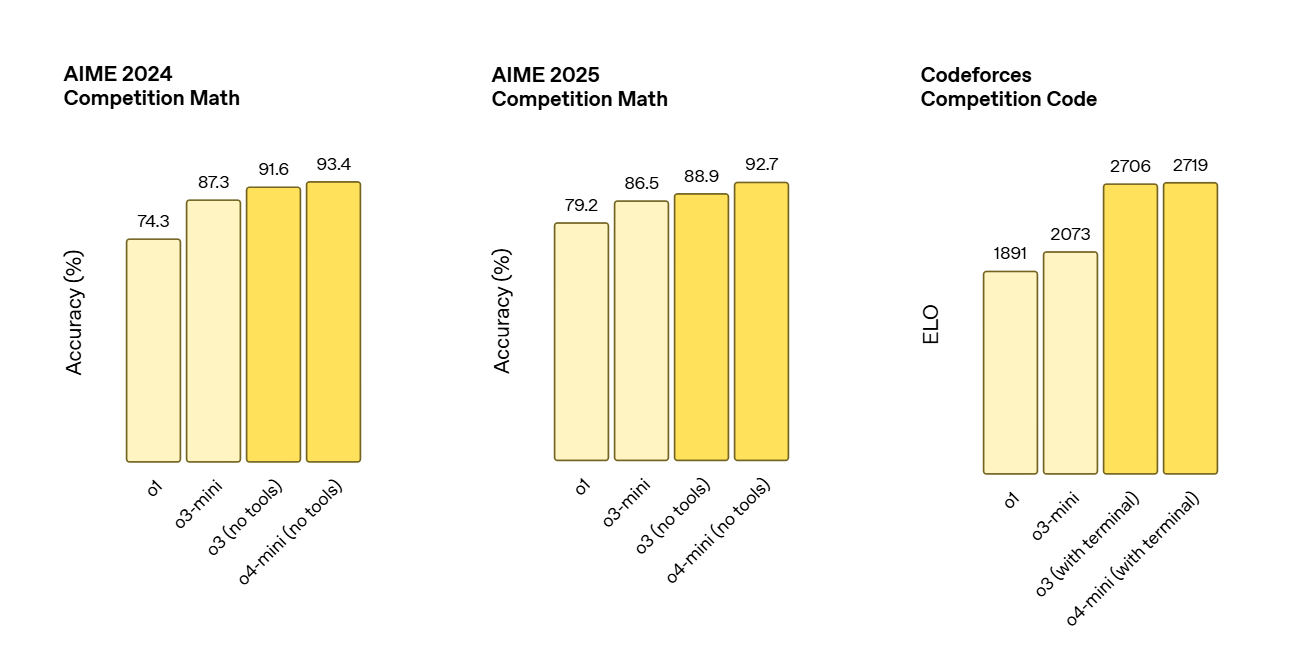

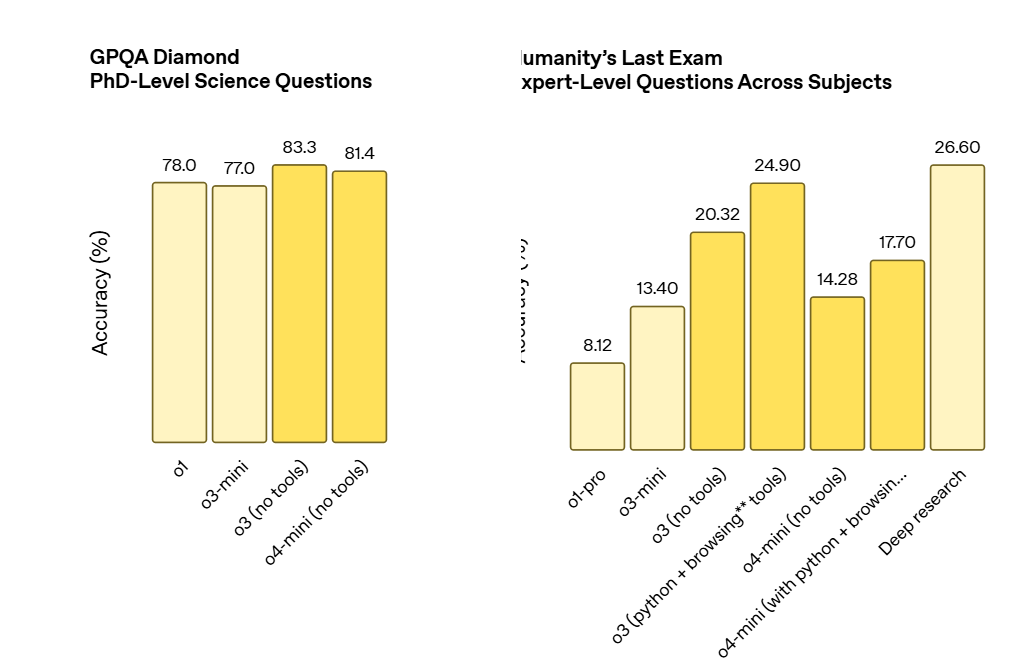

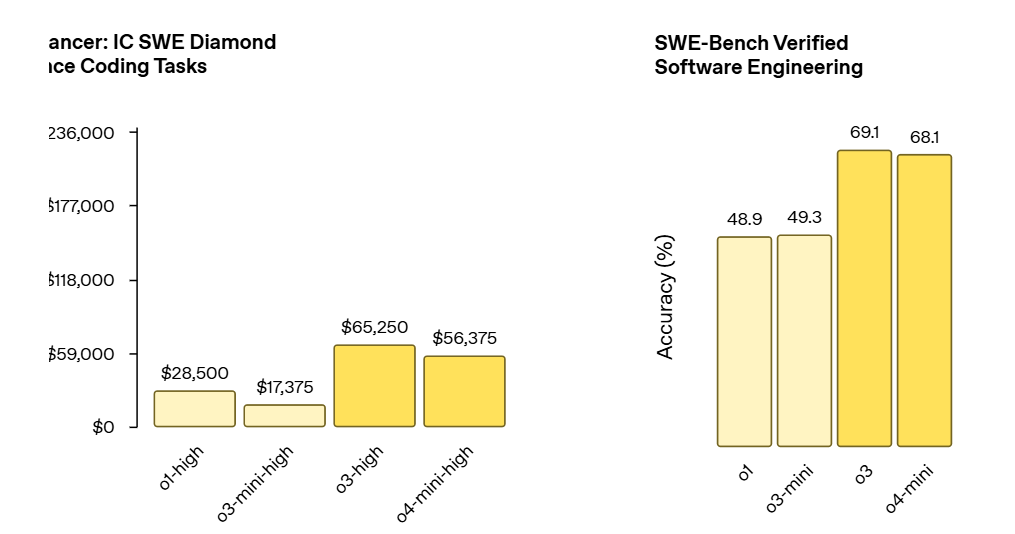

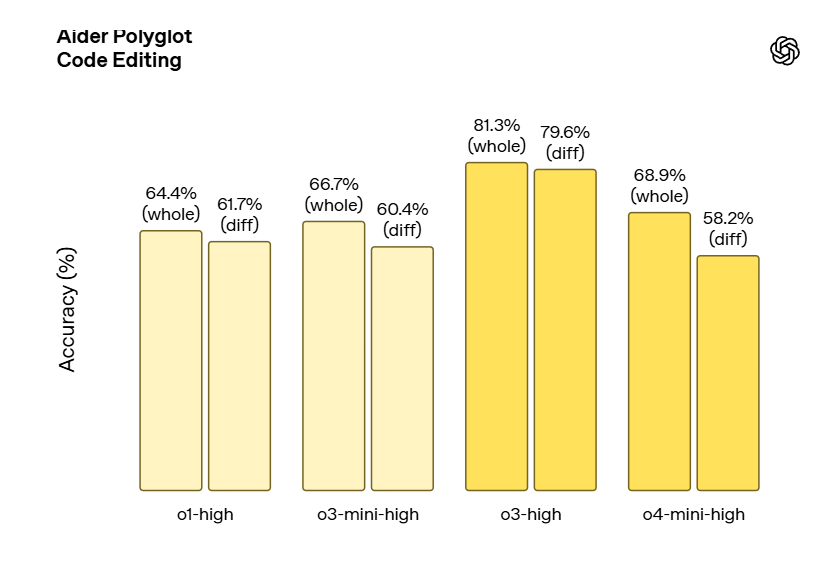

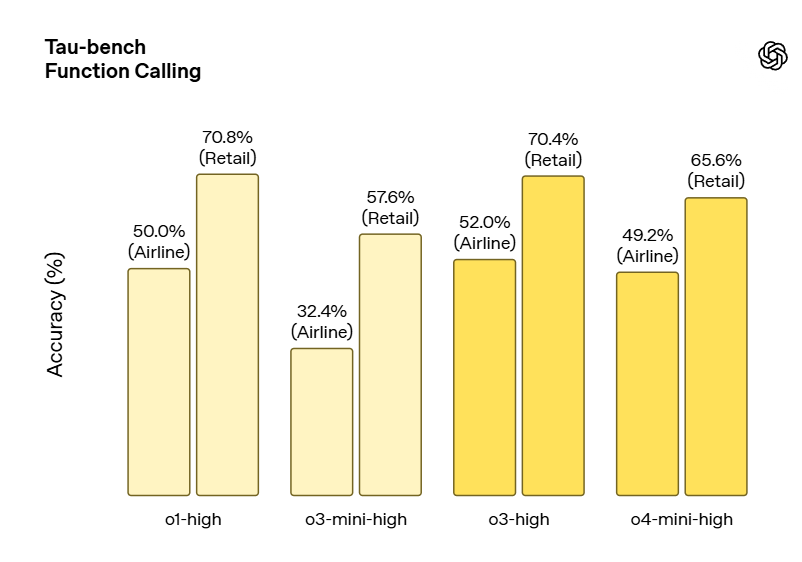

- Устанавливает новые рекорды на бенчмарках, таких как Codeforces, SWE-bench, MMMU

- Исключительно сильна в анализе изображений, диаграмм и графиков

- Снижает количество серьёзных ошибок на 20% по сравнению с o1 в реальных задачах

- Высоко оценена в областях программирования, креативного мышления, биологии, математики и инженерии

o4-mini

- Компактная модель, оптимизированная по скорости и стоимости

- Впечатляющая производительность на AIME 2024–2025 с использованием Python (99,5% pass@1)

- Превосходит o3-mini как в STEM, так и в не-STEM задачах (например, в data science)

- Позволяет использовать больше запросов, чем o3, подходит для высокой частоты обращений

Мультимодальность

Кодирование

🧠 Визуальное рассуждение

- Может напрямую интегрировать изображения в цепочки рассуждений

- Понимает размытые изображения, рукописные доски, учебники или эскизы

- Может вращать, увеличивать и редактировать изображения в процессе рассуждения

- Лидирует в мультимодальных тестах

🔧 Использование инструментов как настоящий агент

Пример: вопрос “Какое потребление электроэнергии в Калифорнии этим летом по сравнению с прошлым годом?”

→ o3 может:

- Искать данные коммунальных служб

- Писать код на Python для генерации прогнозов

- Создавать графики, анализировать тренды

- Гибко подключать инструменты, проактивно искать дополнительные данные при необходимости

⚙️ Оптимизация эффективности и стоимости

- o3 умнее и экономичнее, чем o1

- o4-mini значительно эффективнее, чем o3-mini

- Для большинства реальных сценариев o3 и o4-mini умнее и дешевле предыдущих моделей

🔒 Безопасность и контроль

- Полностью обновлённые данные для обучения по безопасности

- Улучшена способность отказываться отвечать на чувствительный контент (биологическое оружие, вредоносное ПО и т.д.)

- Система мониторинга LLM обнаруживает ~99% опасных red-team атак

- Тщательно оценены по направлениям самообучающегося ИИ, сетевой безопасности и биологии – не представляют высокого риска

💻 Codex CLI – Прямое рассуждение из командной строки

- Лёгкий агент для программирования, который может работать прямо в терминале

- Поддерживает отправку изображений, рисунков, скриншотов для совместного локального анализа кода

- Открытый исходный код на GitHub

- Грантовый фонд $1 млн для проектов, использующих Codex CLI (API кредиты $25k на проект)

🔓 Доступ и распространение

- Пользователи ChatGPT Plus, Pro и Team могут выбрать o3, o4-mini, o4-mini-high

- Пользователи Enterprise и Edu получат доступ через 1 неделю

- Бесплатные пользователи могут попробовать o4-mini через кнопку “Think”

- API полностью поддерживается через Chat Completions и Responses

- Вскоре API Responses будет поддерживать интеграцию инструментов: веб-поиск, поиск файлов, написание кода

Source: https://openai.com/index/introducing-o3-and-o4-mini/