Hoje, a OpenAI lança oficialmente dois novos modelos: o3 e o4-mini – as versões mais avançadas da série de modelos “o”, treinadas para pensar por mais tempo antes de responder. Estes são os modelos mais inteligentes já lançados, permitindo que o ChatGPT lide com tarefas complexas com capacidades profundas de raciocínio e uso proativo de ferramentas.

Pela primeira vez, esses modelos podem usar toda a suíte de ferramentas do ChatGPT: busca na web, leitura e análise de arquivos via Python, processamento de entradas de imagem e geração de imagens. Eles foram projetados para decidir autonomamente quando e como usar as ferramentas, respondendo rapidamente (geralmente em menos de 1 minuto) no formato de saída apropriado.

🚀 Principais Novos Recursos

o3-mini

- O modelo de raciocínio mais poderoso até hoje

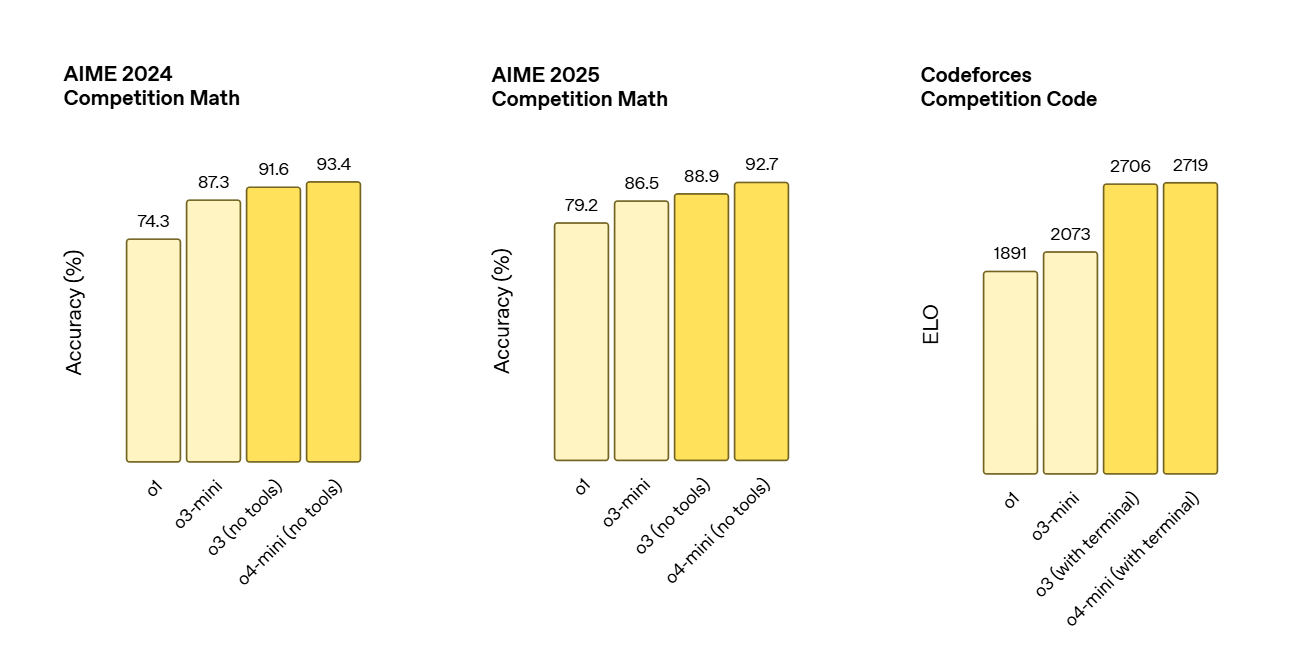

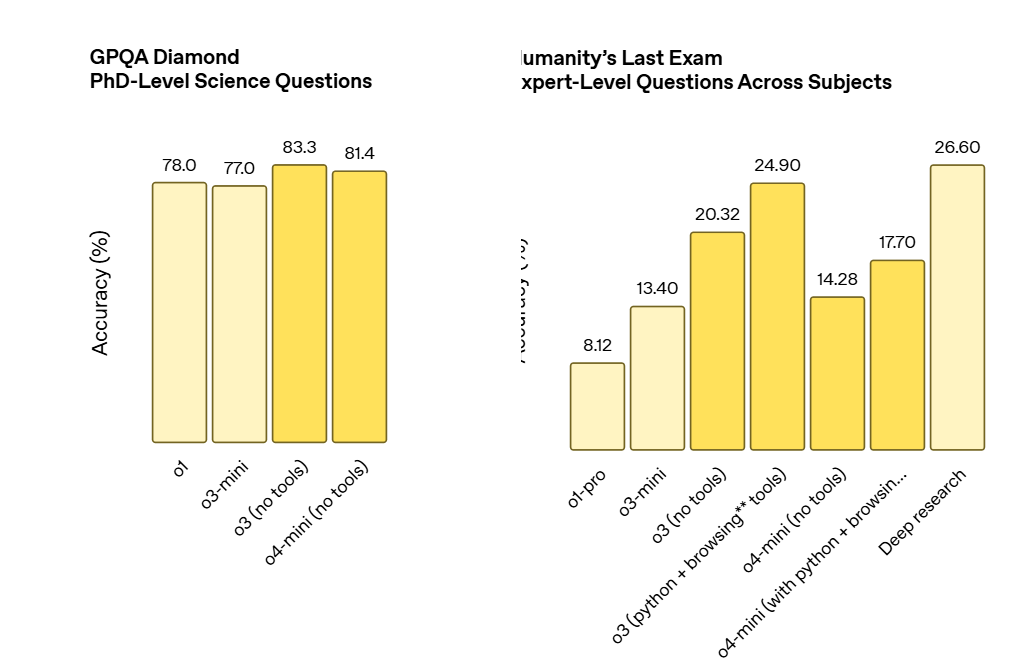

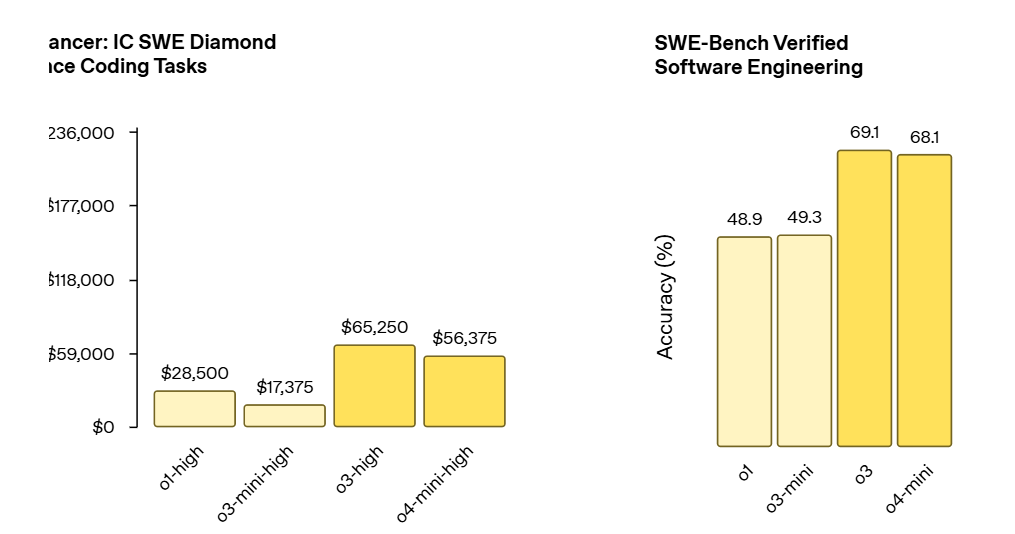

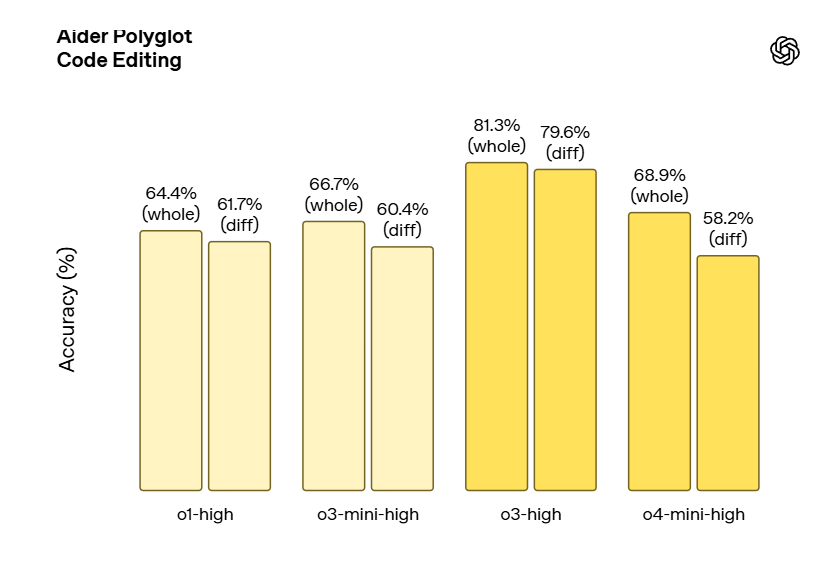

- Estabelece novos recordes em benchmarks como Codeforces, SWE-bench, MMMU

- Extremamente forte na análise de imagens, gráficos e tabelas

- Reduz erros graves em 20% em comparação ao o1 em tarefas do mundo real

- Altamente avaliado em áreas como programação, pensamento criativo, biologia, matemática e engenharia

o4-mini

- Modelo compacto, otimizado para velocidade e custo

- Desempenho impressionante no AIME 2024–2025 usando Python (99,5% pass@1)

- Supera o o3-mini em tarefas STEM e não-STEM (como ciência de dados)

- Permite limites de uso mais altos que o o3, adequado para alta frequência de consultas

Multimodal

Código

🧠 Raciocínio Visual

- Pode integrar imagens diretamente em cadeias de raciocínio

- Compreende imagens borradas, quadros escritos à mão, livros didáticos ou esboços

- Pode girar, ampliar e editar imagens durante o raciocínio

- Lidera em testes multimodais

🔧 Usando ferramentas como um verdadeiro agente

Exemplo: a pergunta “Como o consumo de eletricidade na Califórnia neste verão se compara ao do ano passado?”

→ o3 pode:

- Buscar dados públicos de concessionárias

- Escrever código Python para gerar previsões

- Criar gráficos, analisar tendências

- Conectar ferramentas de forma flexível, buscar dados adicionais de forma proativa se necessário

⚙️ Otimização de eficiência e custo

- o3 é mais inteligente e econômico que o o1

- o4-mini é significativamente mais eficiente que o o3-mini

- Para a maioria dos cenários do mundo real, o o3 e o o4-mini são mais inteligentes e baratos que os modelos anteriores

🔒 Segurança e controle

- Dados de treinamento de segurança totalmente atualizados

- Capacidade aprimorada de recusar responder a conteúdos sensíveis (armas biológicas, malware, etc.)

- Sistema de monitoramento LLM detecta ~99% dos desafios perigosos de red-team

- Avaliado minuciosamente para IA autoaprendente, segurança de rede e biologia – não apresenta níveis elevados de risco

💻 Codex CLI – Raciocínio direto pelo terminal

- Agente de codificação leve que pode rodar diretamente no terminal

- Suporta envio de imagens, desenhos, capturas de tela para raciocínio de código local combinado

- Código aberto no GitHub

- Fundo de subsídios de US$ 1 milhão para projetos usando Codex CLI (créditos de API de US$ 25 mil por projeto)

🔓 Acesso e distribuição

- Usuários do ChatGPT Plus, Pro e Team podem escolher o o3, o o4-mini, o o4-mini-high

- Usuários Enterprise e Edu terão acesso após 1 semana

- Usuários gratuitos podem experimentar o o4-mini pelo botão “Think”

- API totalmente suportada via Chat Completions e Responses

- A API de Responses em breve suportará integração de ferramentas: busca na web, busca de arquivos, escrita de código

Fonte: https://openai.com/index/introducing-o3-and-o4-mini/